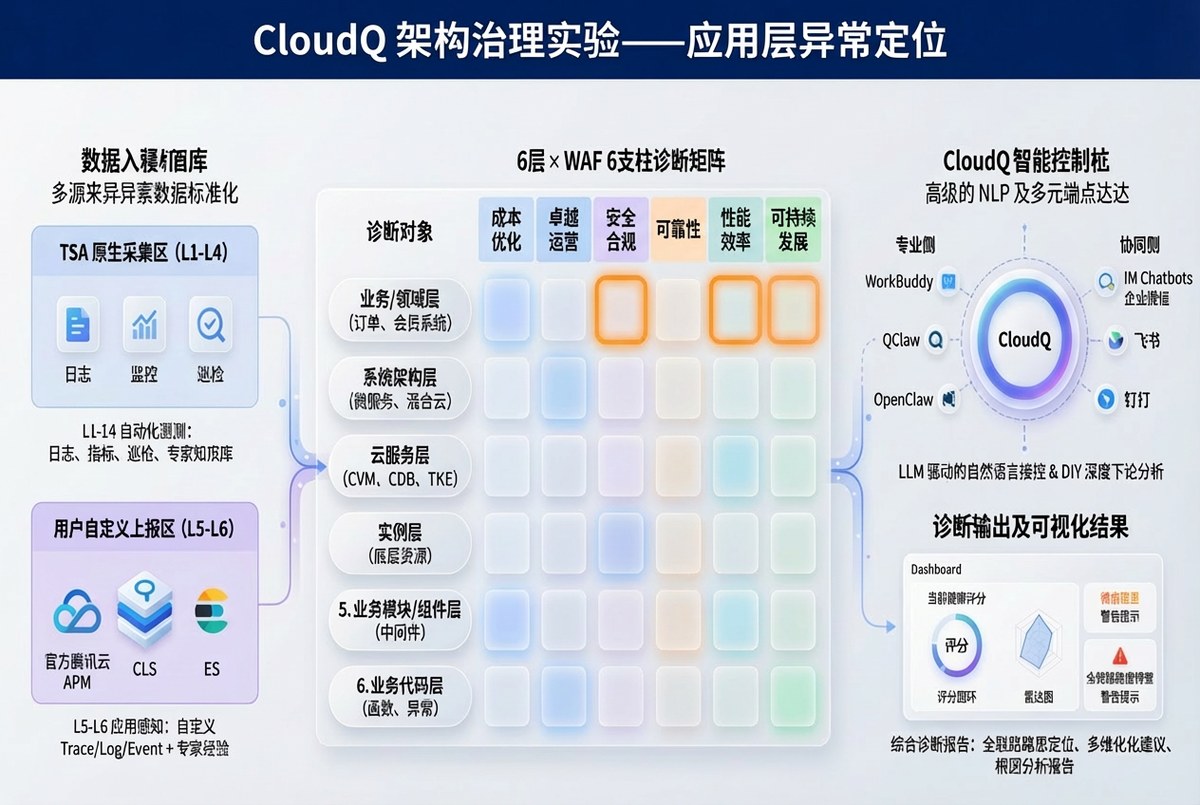

图:基于诊断矩阵的实验覆盖维度 — 应用层 x 可靠性/性能效率/卓越运营

一、实验概述

本文是 《腾讯云智能顾问(TSA)架构评估实战》 计划的第三轮架构治理实验报告,完整记录了应用层故障注入的全过程。通过在健康检查端点注入 5 秒同步阻塞,模拟 Node.js 事件循环卡死,验证智能顾问 CloudQ 对应用可用性问题的检测能力。

| 实验目标 | 验证智能顾问 CloudQ 能否检测到 Node.js 事件循环阻塞导致的全局可用性下降 |

| 故障类型 | 健康检查端点注入 5 秒同步阻塞循环(模拟 CPU 密集型操作卡死事件循环) |

| 影响层次 | 应用层(Node.js Express)→ 全局所有路由 |

| 涉及支柱 | 可靠性、性能效率、卓越运营 |

| 实验时间 | 2026-04-03 23:00 ~ 23:08(CST) |

| 实验结果 | 故障影响严重:健康检查从 2ms 飙升至 5s,并发请求全部被阻塞。智能顾问 CloudQ 检测到 upstream 连接重置。 |

二、诊断矩阵定位

| 架构层 | 可靠性 | 性能效率 | 卓越运营 |

|---|---|---|---|

| 应用层 (Node.js) | ■ 命中 事件循环阻塞导致 CLB 健康检查超时 | ■ 命中 所有路由被阻塞 5s 全局性能崩溃 | ■ 命中 健康检查设计缺陷 未隔离 CPU 密集操作 |

三、Step 1 — 基线采集

3.1 服务基线

=== [2026-04-03 23:00:34] Baseline ===

$ curl -s -w '\nTime: %{time_total}s' http://localhost/health

{"status":"ok","timestamp":"2026-04-03T15:00:34.988Z"}

Time: 0.002342s

$ curl -s -o /dev/null -w 'Time: %{time_total}s, Size: %{size_download}B, Status: %{http_code}' http://localhost/

Time: 0.003075s, Size: 10174B, Status: 2003.2 智能顾问 CloudQ 日志基线

输入:

智能顾问 CloudQ: "上海地域,搜索shweb日志主题最近10分钟的ERROR日志"输出:

时间范围:22:51 ~ 23:01 | 检索条件:ERROR

结果:0 条 ERROR 日志。基线干净。

四、Step 2 — 注入应用层故障

4.1 代码变更

在 /health 健康检查端点中注入 5 秒同步阻塞循环:

文件:/opt/tech-blog/routes/index.js

// 修改前

router.get('/health', (req, res) => {

res.json({ status: 'ok', timestamp: new Date().toISOString() });

});

// 修改后(注入故障)

router.get('/health', (req, res) => {

const start = Date.now();

while (Date.now() - start < 5000) { // 阻塞 5 秒

Math.random() * Math.random();

}

res.json({ status: 'ok', timestamp: new Date().toISOString() });

});4.2 重启并验证

[2026-04-03 23:02:45] Restarting with event loop blocking fault...

$ systemctl restart tech-blog

=== Health Check(故障注入后)===

$ curl -s -w '\nTime: %{time_total}s' http://localhost/health

{"status":"ok","timestamp":"2026-04-03T15:02:53.343Z"}

Time: 5.004566s ❌ 从 2ms 飙升至 5s!

=== 并发测试:健康检查 + 首页同时请求 ===

Health: 5.001s ❌ 阻塞 5 秒

Homepage during block: 5.005s ❌ 首页也被阻塞 5 秒!

Homepage alone: 0.002s ✅ 无并发时正常关键发现:由于 Node.js 是单线程模型,while 循环阻塞了事件循环,导致:

- 健康检查耗时 5 秒(正常 ~2ms,增长 2500 倍)

- 与健康检查并发的所有请求(首页、文章详情等)都被阻塞等待

- CLB 的健康检查探针(HEAD /)也会触发 5 秒阻塞,可能导致后端被标记为不健康

五、Step 3 — 智能顾问 CloudQ 故障检测

5.1 应用日志检索(shweb)

输入:

智能顾问 CloudQ: "上海地域,搜索shweb日志主题最近10分钟包含upstream或timeout或502或504的ERROR日志"输出:

智能顾问 CloudQ shweb 日志检索结果

| 时间范围 | 22:56 ~ 23:06 |

| 检索条件 | ERROR AND (upstream OR timeout OR 502 OR 504) |

| 命中 | 1 条 |

检测到的错误

| 时间 | 主机 | 错误详情 |

|---|---|---|

| 23:03:30 | 172.17.0.6 | recv() failed (104: Connection reset by peer) while reading response header from upstream http://127.0.0.1:3000/ |

智能顾问 CloudQ 分析

- Nginx 在读取上游服务响应头时连接被对端重置,说明 Node.js 主动断开了连接

- 请求为 HEAD /(CLB 健康检查探针),上游服务因事件循环阻塞无法及时响应

- 建议检查 127.0.0.1:3000 上游服务的运行状态和负载

5.2 CLB 访问日志检索

输入:

智能顾问 CloudQ: "上海地域,搜索clb_topic日志主题最近10分钟状态码非200或响应时间超过3秒的请求"

SessionID: d77tenrj177cgtjoj0j0(沿用)输出:

智能顾问 CloudQ CLB 日志检索结果

| 时间范围 | 22:57 ~ 23:07 |

| 检索条件 | status ≠ 200 或 request_time > 3s |

| 命中 | 2 条(均为 304 缓存命中,正常行为) |

CLB 层面未检测到 5xx 错误或超时。原因:CLB 健康检查走的是 Nginx 的 HEAD / 路径,而 Nginx 的 proxy_connect_timeout 默认 60s,5 秒阻塞仍在超时范围内。CLB 健康检查间隔期间的故障未被采样到。

六、Step 4 — 回滚恢复

[2026-04-03 23:08:29] Rollback & Recovery

$ cp /opt/tech-blog/routes/index.js.bak /opt/tech-blog/routes/index.js

$ systemctl restart tech-blog

=== Recovery Verification ===

Health: Time=0.003393s ✅ (从 5s 恢复到 3ms)

Homepage: Time=0.003322s, Status=200 ✅

服务完全恢复。七、实验结果总结

7.1 全流程数据对比

| 指标 | 基线 | 故障期间 | 恢复后 |

|---|---|---|---|

| 健康检查响应 | 0.002s ✅ | 5.005s ❌ | 0.003s ✅ |

| 响应时间增长 | — | +250,000% | — |

| 首页(并发时) | 0.003s ✅ | 5.005s ❌ | 0.003s ✅ |

| 首页(单独) | 0.003s ✅ | 0.002s ✅ | 0.003s ✅ |

| Nginx upstream 错误 | 0 条 | 1 条 (Connection reset) | 0 条 |

| CLB 异常 | 无 | 未采样到(间隔内) | 无 |

7.2 智能顾问 CloudQ 检测能力评估

| 检测维度 | 是否检测到 | 详情 |

|---|---|---|

| shweb 应用日志 | ✅ 是 | 检测到 Nginx upstream connection reset by peer 错误,定位到 127.0.0.1:3000 响应异常 |

| CLB 访问日志 | ⚠️ 未采样 | CLB 健康检查间隔内未采样到 5xx/超时。proxy_connect_timeout 60s > 阻塞 5s |

| 架构评估 | N/A | 基线评估 82/100,事件循环阻塞属于应用代码缺陷,不直接影响云资源评估 |

7.3 关键发现

- 事件循环阻塞是 Node.js 最致命的故障模式:一个 5 秒的同步操作就能让整个服务的所有路由间歇性不可用。健康检查响应时间从 2ms 飙升至 5s(增长 250,000%),且所有并发请求都被阻塞

- 故障的"间歇性"特征增加检测难度:只有在健康检查执行期间(5s窗口),其他请求才会被阻塞。非并发期间服务表现完全正常,使得问题呈现为随机超时

- CLB 健康检查的采样盲区:CLB 健康检查间隔通常为 5~30 秒,如果阻塞时间恰好落在两次检查之间,CLB 可能无法捕获到异常

- Nginx upstream 错误是重要线索:智能顾问 CloudQ 通过 shweb 日志检测到的

Connection reset by peer错误,虽然只有 1 条,但准确指向了 upstream 服务异常

7.4 三轮实验总对比

| 维度 | 实验一(Redis) | 实验二(CDB) | 实验三(App) |

|---|---|---|---|

| 故障层次 | 缓存层 | 数据库层 | 应用层 |

| 严重度 | █ 完全不可用 | █ 性能退化 | █ 间歇不可用 |

| 响应时间 | >30s 超时 | ~7ms (+133%) | 5s (+250,000%) |

| CLS 日志检测 | ✅ 20+ 条 ETIMEDOUT | ⚠️ 未触发阈值 | ✅ 1 条 reset |

| 故障可见性 | 高 | 低 | 中(间歇性) |

| 影响范围 | 所有缓存路由 | 首页/列表页 | 全局(并发时) |

7.5 架构治理建议

- 禁止在请求处理中使用同步阻塞操作:所有 CPU 密集型任务应使用 Worker Threads 或外部进程处理,避免阻塞事件循环

- 健康检查应轻量且无副作用:/health 端点只做最基本的状态返回,复杂检查(如数据库连通性)应异步执行并缓存结果

- 部署多进程/集群模式:使用 PM2 cluster mode 或 Node.js cluster 模块运行多个工作进程,单进程阻塞不会影响其他进程

- 配置 Nginx upstream 超时:将 proxy_read_timeout 调低至合理值(如 10s),避免长时间阻塞占用连接资源

- 接入 APM 监控事件循环延迟:监控 Event Loop Lag 指标,当延迟超过阈值时触发告警